Technologia AI w służbie ludzi z niepełnosprawnościami. Bo najlepsza technologia to taka, która zmienia czyjeś życie.

Wyzwanie

Osoby niewidome i niedowidzące zmagają się codziennie z barierami, które widzący uważają za oczywiste. Przeczytanie etykiety produktu, rozpoznanie banknotów, nawigacja w nowym budynku.

Istniejące rozwiązania są fragmentaryczne. Osobna apka do OCR, osobna do rozpoznawania obiektów, żadna nie prowadzi naturalnego dialogu. Potrzebny był jeden asystent, który rozumie kontekst.

Rozwiązanie

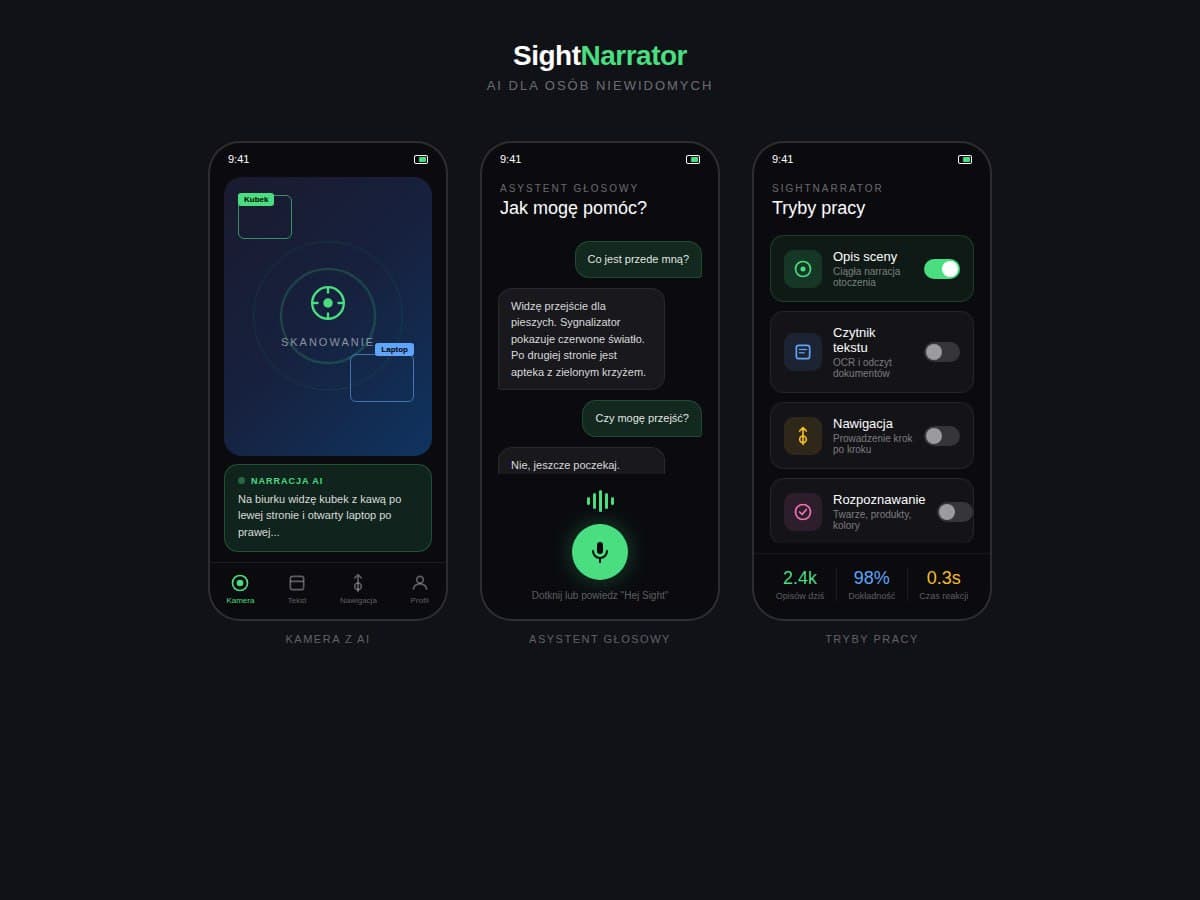

Asystent głosowy prowadzi naturalny dialog z użytkownikiem. Nie wymaga precyzyjnych komend. Wystarczy zapytać "co jest przede mną?" i dostać pełny opis sceny.

Rozpoznawanie obiektów

Kamera w czasie rzeczywistym identyfikuje przedmioty, osoby i otoczenie. Opis głosowy natychmiast.

OCR w czasie rzeczywistym

Czytanie tekstów, etykiet produktów, dokumentów. Wspiera język polski i wiele innych.

3 tryby pracy

Opis sceny, nawigacja indoor, rozpoznawanie produktów. Przełączanie jednym gestem.

Naturalny dialog głosowy

Nie tylko komendy. Użytkownik prowadzi rozmowę z asystentem. "Co jest przede mną? A co jest po lewej?"

Offline mode

Podstawowe funkcje działają bez internetu. Rozpoznawanie obiektów i OCR dostępne zawsze.

🛠 Tech Stack

Stack zoptymalizowany pod accessibility i wydajność offline. Każdy wybór ma powód.

🌍 Impact

Projekt accessibility, który pokazuje, że AI to nie tylko automatyzacja biznesu. To narzędzie, które może realnie poprawić jakość życia milionów ludzi.

Potrzebujesz podobnego rozwiązania?

Aplikacje mobilne z AI, accessibility, computer vision. Porozmawiajmy o Twoim projekcie.